«Я считаю, это очень хорошо, что Сейм поддержал такой законопроект. Логично, что это необходимо. Потому что уже сейчас искусственный интеллект настолько развит, мы можем с помощью искусственного интеллекта сделать настолько много, что уже невозможно сказать, настоящее ли то, что мы видим или слышим, или это фейк.

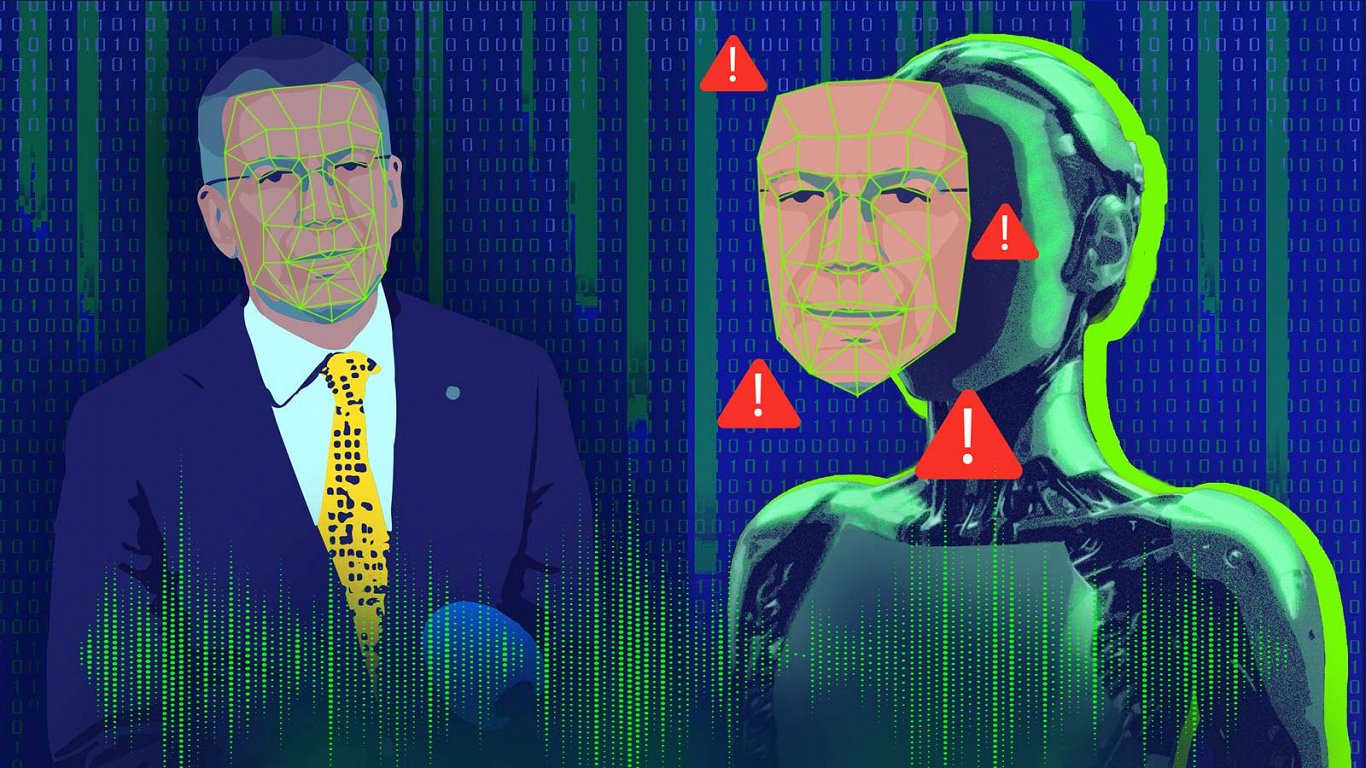

Поэтому такой закон, я считаю, необходим. Ведь если с помощью такого фейкового контента кто-то будет влиять, например, на такое важное событие, как выборы, то надо как-то с этим бороться», — прокомментировал Артур Меднис принятый Сеймом на этой неделе закон об уголовной ответственности за попытки воздействовать на выборы с помощью дипфейка, т.е. сгенерированного с помощью искусственного интеллекта.

Специалист констатировал: отдельный вопрос, как этот закон будет применяться на практике.

«Я сам хотел бы узнать ответ на этот вопрос, потому что я не могу даже представить, как и, главное, кто и каким образом сможет не только доказать, что это фейк. Ну, допустим, доказать смогут. Но как найти создателя этого фейка, если он будет распространен через разные фейковые аккаунты в соцсетях?» — объяснил он, в чем, по его мнению, заключается проблема.

Впрочем, считает он, важно, что этот закон вообще появился, поскольку он предусматривает саму возможность, искать виновных в создании подделок и привлекать их к ответственности.

На вопрос, действительно ли дипфейки нельзя распознать, А. Меднис заверил: вы бы не распознали.

«Я, мои коллеги, мы можем считать, что мы там такие умные, но будем откровенны: даже мы бы не смогли бы отличить, если это качественно сделано», — заявил он.

И тут же пояснил: он сам делал подобный контент, в том числе о себе самом — аудио, видео Артуром Меднисом, чрезвычайно правдоподобным, но полностью сгенерированным компьютером.

«Я просто написал, что мне сказать в моем видео […]. То есть уже сейчас есть возможность. Инструмент, которым я пользовался, никакой не секретный, им пользуются и другие. А представьте себе, если этим займется политическая партия или какие-то преступники, у которых возможностей еще больше, у которых есть бюджеты для такого? Это все довольно серьёзно. И в будущем таких фейков будет все больше, важно заранее об этом думать», — заключил он.

Rus.LSM.lv рассказывал о мошеннических роликах, которые зимой стали появляться в соцсетях — в них журналисты Латвийского телевидения и президент страны Эдгар Ринкевич как будто рекламировали некую инвестиционную платформу, обещая огромные доходы участникам.